使用场景 允许用户使用ModelArts控制台提供的CloudShell登录运行中的训练容器。 约束限制 当前新旧版本的专属资源池均支持使用CloudShell,且训练作业必须处于“运行中”状态。 图1 创建训练作业时使用专属资源池 图2 …

共407项

使用场景 允许用户使用ModelArts控制台提供的CloudShell登录运行中的训练容器。 约束限制 当前新旧版本的专属资源池均支持使用CloudShell,且训练作业必须处于“运行中”状态。 图1 创建训练作业时使用专属资源池 图2 …

不同AI模型训练所需要的数据量和算力不同,在训练时选择合适存储及训练方案可提升模型训练效率与资源性价比。ModelArts支持单机单卡、单机多卡和多机多卡的训练场景,满足不同AI模型训练的要求。针对第一次使用ModelArts的用户,本文提…

本文为您介绍如何通过AI Gallery订阅LLaMA系列算法,并在ModelArts使用昇腾Snt9b芯片进行算法的训练微调和模型的推理部署。 场景介绍 LLaMA是基于Transformer结构的自回归语言模型,提供多种尺寸的LLaMA…

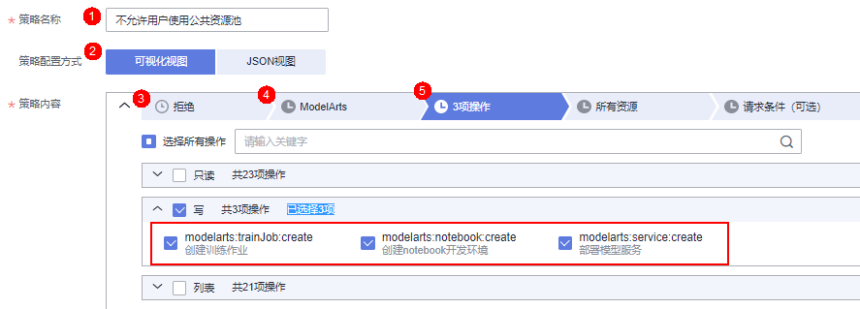

本章节介绍如何控制ModelArts用户权限,限制用户使用Modelarts公共资源池的资源创建训练作业、创建开发环境实例,部署推理服务等。 场景介绍 对于ModelArts专属资源池的用户,不允许使用公共资源池创建训练作业、创建Noteb…

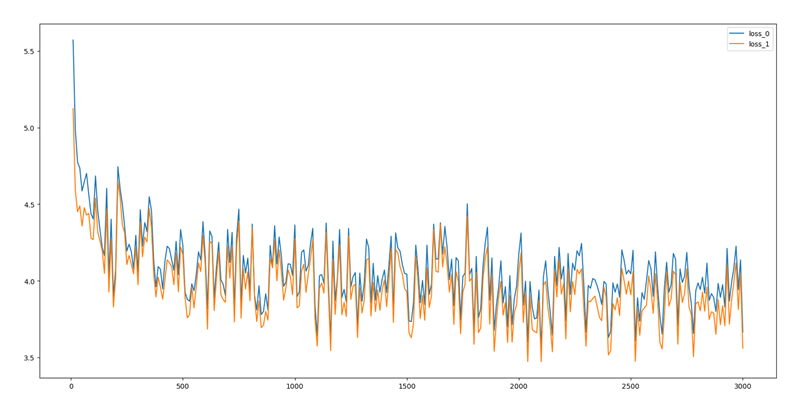

精度问题是指模型从GPU设备迁移到昇腾NPU设备之后由于软硬件差异引入的精度问题。根据是否在单卡环境下,可分为单卡精度问题与多卡精度问题。多卡相对于单卡,会有卡与卡之间的通信,这可能也是精度偏差的一种来源。所以多卡的精度对齐问题相对于单卡会…

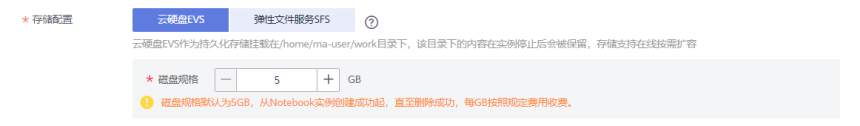

购买弹性文件服务SFS 弹性文件服务默认为按需计费,即按购买的存储容量和时长收费。您也可以购买包年包月套餐,提前规划资源的使用额度和时长。在欠费时,您需要及时(15天之内)续费以避免您的文件系统资源被清空。SFS购买指导请参考如何购买弹性文…

本文为您介绍如何通过AI Gallery订阅ChatGLM系列算法,并通过ModelArts进行算法的训练微调和模型的推理部署。 场景介绍 ChatGLM-6B是一个开源的、支持中英双语问答的对话语言模型,基于 General Langua…

问题现象 图1 报错信息 原因分析 transformers库的tranining_args.py目前适配的是CUDA的部分操作,需要替换为适配NPU的脚本。 处理方法 tranining_args.py替换为适配NPU的脚本,替换的脚本请…

第三方案例来源为华为云开发者社区“云驻计划”。由于ModelArts产品的持续更新和迭代,第三方案例中的界面和步骤可能因时效性而与最新产品有所差异,仅供学习和参考。 表1 第三方案例列表 分类 文章名称 作者 自动学习 2步打通ModelA…

问题现象 报错提示OSError: [Errno 122] Disk quota exceeded。 原因分析 默认情况下,下载数据集缓存目录为“~/.cache/huggingface/dataset”,Huggingface缓存目录空间…